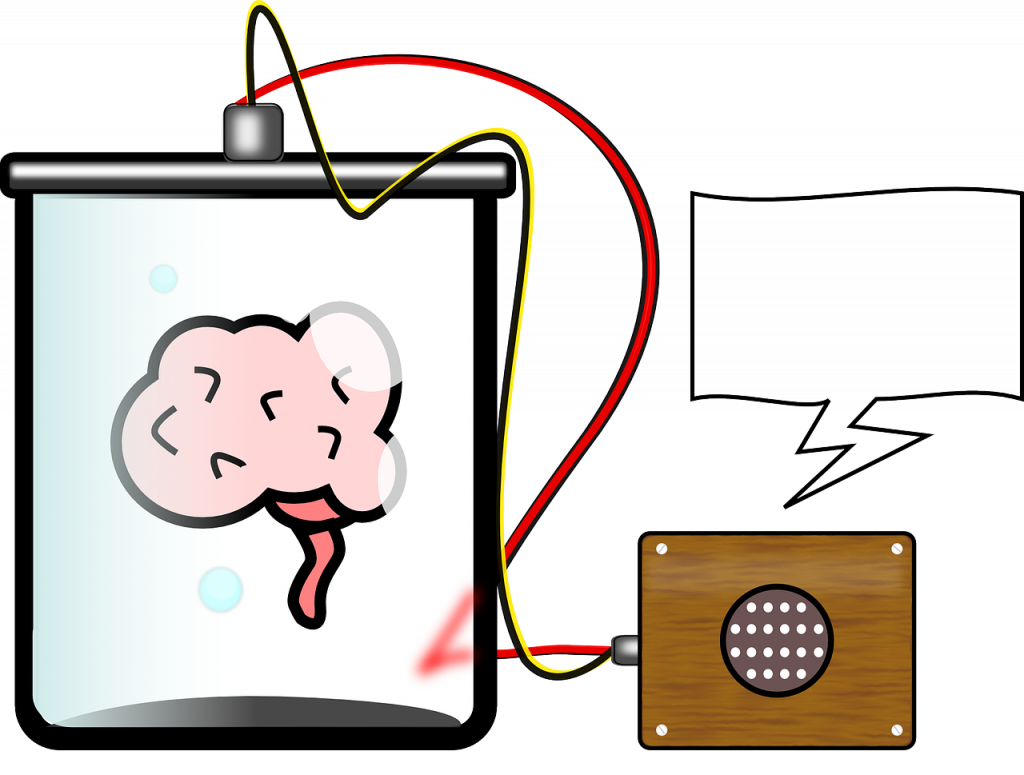

Инженеры-нейробиологи (нейроинженеры) из Колумбийского Университета в Нью-Йорке завершили разработку системы, которая позволяет переводить мысли в звучащую речь. Сейчас эта система способна на основе анализа активности мозга реконструировать те слова, которые человек слышит. Но в перспективе ученые надеются, что она сможет считывать любые мозговые импульсы и синтезировать из них речь.

Новые технологии будут полезны при оказании помощи немым, людям, которые обладают глобальными речевыми дефектами, пациентам, страдающих боковым амиотрофическим склерозом или восстанавливающимся после инсульта. Сообщение об исследовании и результаты были опубликованы в журнале Scientific Reports.

«Ежедневно используя голос и способности к речевым коммуникациям, мы поддерживаем тесную связь с нашими близкими и миром вокруг. Именно поэтому даже частичная потеря речевых навыков является тяжелыми испытаниями для любого человека», — рассказывает Нима Месгарани, главный автор заявленной научной статьи и старший исследователь в Институте Мортимера Цукермана в Колумбийском Университете. «Благодаря сегодняшним открытиям, учёные получают серьёзный шанс предотвратить трагедию. Вооружившись специальными технологиями, мы можем помочь пациентам в прямом смысле „донести“ их мысли до окружающих, анализируя их с помощью речевого аппарата».

Результаты десятилетий научной работы показали, что, когда люди разговаривают или представляют себе разговор с помощью воображения, в определённых, чётко-очерченных местах их мозга наблюдается повышенная активность. Похожая картина нервных импульсов также складывается при прослушивании чьей-то речи и воспоминаниях о разговоре. Эксперты говорят, что совсем скоро может стать реальностью будущее, где мысли могут успешно выйти за знакомые нам границы головного мозга и мгновенно транслироваться в ясную речь.

Задачи перевода сигналов мозга в речь очень сложна. Ранние попытки расшифровывания нейронных импульсов, предпринятых доктором Месгарани и его командой, в большей степени концентрировались на создании простых компьютерных моделей для анализа выбранной спектрограммы — визуальной репрезентации звуковых частот.

Такой подход к делу не помог осуществить главную задачу — создание программы на основе искусственного интеллекта, которая могла бы расшифровывать мозговую активность человека, превращая её в обычную речь. Проект вскоре был закрыт, а доктор Месгарани и его команда обратили своё внимание на новую технологию — вокодер. Это устройство синтеза речи на основе произвольного сигнала с богатым спектром, способное порождать полноценные предложения, обучаясь на аудиозаписях человеческих разговоров.

«Это абсолютна та же самая технология, которую вы видите в Amazon Echo (голосовой помощник от Amazon, работающий на основе технологии Alexa) и голосовом управлении Siri. Эти продукты используют программу, чтобы давать устный ответ на наши вопросы», рассказывает доктор Месгарани.

Чтобы научить вокодер распознавать и интерпретировать электрическую активность мозга, к доктору Месгарани присоединился доктор медицинских наук, нейрохирург в Northwell Health Physician Partners Neuroscience Institute Ашеш Динеш Мехта. Он стал одним из соавторов работы. Доктор Мехта работает с пациентами, страдающими эпилепсией, и большинство из них нуждаются в регулярных хирургических вмешательствах.

«Работая с доктором Мехта, мы попросили пациентов, восстанавливающихся после недавней операции, прослушать ряд предложений на аудиозаписях, используя разную частоту и тон голоса, — говорит Месгарани. — Зафиксированная мозговая активность пациентов стала основой для обучения вокодера при распознании и реконструкции человеческой речи».

Далее учёные попросили тех же пациентов прослушать голосовое сообщение, которое повторяло обычный счёт от 0 до 9. На этот раз импульсы, возникающие в определённых частях головной коры мозга, напрямую транслировались в вокодер. После анализа звуковых сигналов и их обработки искусственными нейросетями, механизм произвёл имитацию человеческой речи.

Конечным результатом стал роботический голос, который повторял заданную последовательность цифр. Чтобы проверить точность аудиозаписи и эксперимента, доктор Месгарани и его команда собрали аудиторию незаинтересованных в успехе работы третьих лиц для получения независимой оценки проведённого исследования.

«В целом, люди могли прекрасно понимать то, о чём говорилось в аудиозаписи и даже повторять за ней примерно в 75% случаях, что значительно превышает успех в распознавании речи всех предыдущих экспериментов», — отмечает доктор Месгарани. Серьёзный успех в применении интеллектуального синтеза, достигнутый при помощи нейросетей, особенно заметен при сравнении аудиозаписей, созданных на основе спектрограммы и оставленных предыдущими исследователям. «Благодаря более чувствительному вокодеру и использованию нейросетей, наш речевой синтез приблизился к настоящему, обычному человеческому голосу при повествовании».

В будущем доктор Месгарани и его команда планируют использовать более сложные слова и предложения, а также тестировать свой алгоритм при непосредственном участии испытуемого в разговоре. Учёные надеются на то, что их система станет частью медицинского импланта, похожего на те, которые сейчас используются в нейрохирургии для пациентов с эпилепсией, напрямую транслируя мысли человека с повреждённым речевым аппаратом в полноценные предложения.

«При таком развитии событий любой пациент, обладающий этим чипом, может просто сформулировать чёткое словосочетание, такое как „я хочу пить“ или „я хочу стакан воды“, у себя в голове и система сможет автоматически транслировать мысленный сигнал в понятную и разборчивую речь, нужную для привлечения внимания медсестры или ассистента», объясняет доктор Месгарани. «Программа сможет дать шанс людям с повреждениями речевого аппарата оставаться на связи с внешним миром, с их близкими и родными».

Источники

- Columbia Engineers Translate Brain Signals Directly into Speech

- Hassan Akbari, Bahar Khalighinejad, Jose L. Herrero, Ashesh D. Mehta, Nima Mesgarani. Towards reconstructing intelligible speech from the human auditory cortex