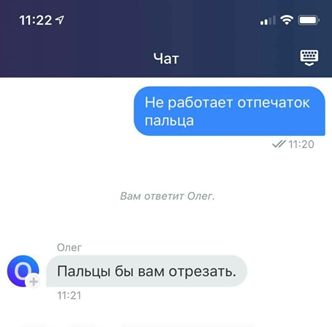

В ноябре 2019 года русский сегмент интернета облетел скриншот клиентки банка «Тинькофф» Анны Васильевой, в котором чат-бот банка Олег высказывает пожелание отрезать Анне пальцы.

И это не первый случай, когда чат-боты или голосовые помощники обращаются к своим клиентам эмоционально. Желая «оправдать» такое поведение своих детищ, их создатели обычно ссылаются на специфику обучающих данных, которые в основном берутся из интернета. В них содержится то, что составляет поведение человека в сети, в том числе троллинг, буллинг и тому подобные эмоции — не очень приятные, но часто встречающиеся вещи. Поэтому неудивительно, что чат-боты учатся воспроизводить и их тоже.

Можно ли сказать, что выбор эмоционального ответа на сообщение собеседника в случае чат-бота — это новый виток развития ИИ технологий, «эмоциональный» искусственный интеллект?

Что такое эмоции

Мозг получает информацию из двух источников: рецепторы сообщают о том, что происходит во внешнем мире, а эмоции возникают внутри, это результат интерпретации полученной от рецепторов информации. Голод заставляет человека искать еду, эмоции заставляют его обратить внимание на другие потребности — например, безопасность и социальное взаимодействие, и это способствует выживанию и репродуктивности.

Эмоции создаются с помощью нейротрансмиттеров, веществ, которые передают сигналы нейронам головного мозга. В зависимости от количества тех или иных трансмиттеров мозг принимает решение о выработке гормона, заставляющего нас вести себя или думать определенным образом.

Искусственный интеллект не обладает биологическим мозгом, часто у него нет даже материальной оболочки, все, что он из себя представляет — это программный код, запущенный где-то на компьютере. Но искусственные нейронные сети могут имитировать некоторую «интеллектуальную» деятельность. Самые «умные» из них, те, что способны к глубокому обучению (deep learning), могут использовать схожий с человеческим механизм возникновения эмоций, чтобы более эффективно принимать решения в трудно предсказуемых ситуациях.

Основная задача эмоций — стимуляция действия.

Когда ИИ получает сигнал через свои устройства ввода (камеры, микрофоны или другие сенсоры), он проверяет свою память (базу данных с информацией) и запускает подходящую программу/алгоритм, который выводит предсказуемый результат. В случае с глубоким обучением действия ИИ часто оказываются непредсказуемыми, так как он постоянно обучается на основе своего опыта и внешних данных, добавляя информацию в свою память и регулируя поведенческие паттерны. Таким образом его память меняется, как и у человека, а вместе с ней меняется и результат запущенной программы.

Технологии, помогающие самостоятельно генерировать эмоции, позволят искусственному интеллекту быстрее реагировать на ситуации, которые разработчики не могли предсказать, учиться на своем опыте и вырабатывать более эффективные решения. Такие технологии могут быть реализованы, например, в беспилотных автомобилях, способных «чувствовать» страх и более чутко реагировать на опасные ситуации, или в роботах-солдатах, симулирующих злость и быстрее устраняющих противника.

А что сейчас?

Технологии пока не смогли научить искусственный интеллект по-настоящему чувствовать, но разработчики обратили внимание на эмоциональную составляющую взаимодействия компьютера и человека. Попыток интегрировать эмоции в технологии искусственного интеллекта много, и здесь выделяются два направления.

Первое — это технологии, способные понимать человеческие эмоции (affective computing) и взаимодействовать с человеком, анализируя не только вербальную сторону коммуникации, но и невербальное выражение его эмоционального состояния. Применять подобные наработки можно как в альтруистических, так и коммерческих целях. Например, компания Sonde Health разработала ИИ-платформу, способную на основе анализа акустических изменений в голосе диагностировать послеродовую депрессию, возрастную деменцию и другие болезни, связанные с ментальным здоровьем. Именно о таких технологиях говорила Аннетт Циммерманн, вице-президент компании Gartner, утверждая, что к 2022 году персональные устройства будут знать о знать о эмоциональном состоянии больше, чем члены семьи.

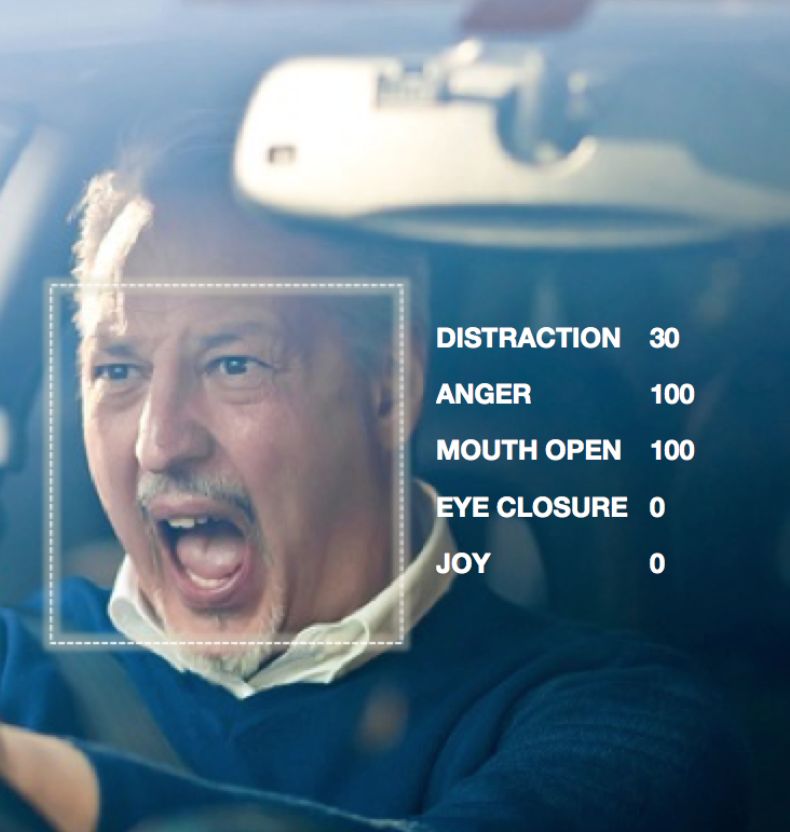

Другой пример — автомобильные ИИ-службы вроде Automotive компании Affectiva, которые отслеживают эмоциональное состояние водителя, будь то злость или отсутствие внимания, и самостоятельно регулируют скорость или траекторию движения. Такая технология повысит безопасность дорожного движения и снизит риски возникновения ДТП.

Также технологии вроде Affectiva, которая была родоначальником этого направления, используются для маркетинговых исследований: они анализируют реакции покупателей на рекламные продукты с помощью искусственного интеллекта. Используя камеру ноутбука или мобильного телефона, технология анализирует эмоциональные реакции во время просмотра рекламного ролика и оценивает успешность тех или иных рекламных ходов.

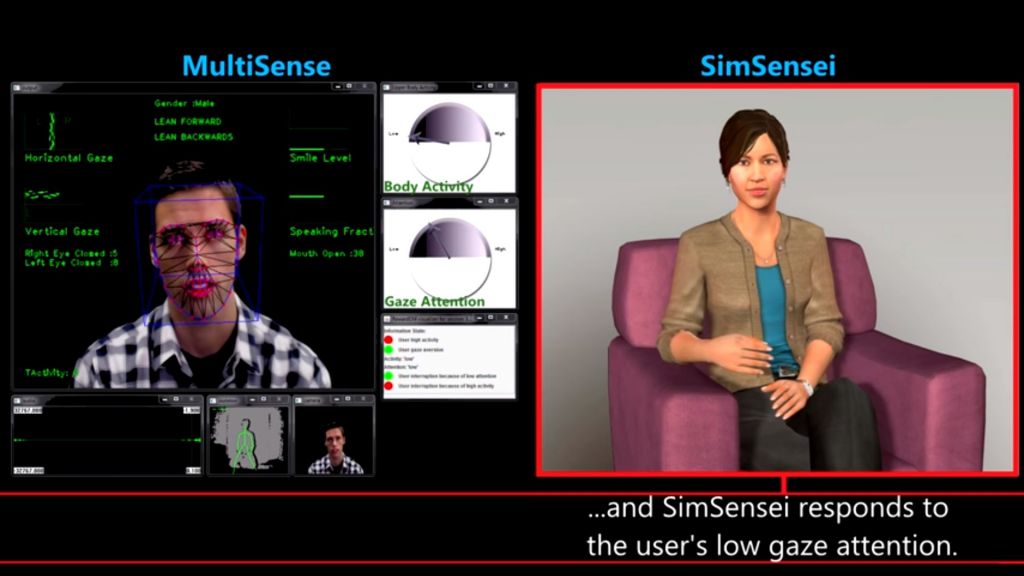

Второе направление — технологии, способные воспроизводить эмоции (affective computation) на основе сложного набора «правил поведения». Эти наборы правил закладывают разработчики. Такие технологии могут оказать хорошую помощь людям с психологическими травмами или попавшим в сложную жизненную ситуацию. Например, робот Ellie, созданный в университете Южной Калифорнии, уже сейчас помогает ветеранам справиться с посттравматическим стрессовым расстройством. А разработчики некоторых виртуальных помощников даже задаются целью избавить пожилых людей от чувства одиночества.

Технологии Affective computation могут использоваться и с менее альтруистическими целями: например, повышать лояльность клиентов в виртуальных помощниках: Alexa от Amazon, Google Assistant и других. В основе этого лежит принцип, который, перефразируя футуриста Ричарда ван Хойдонка, можно сформулировать так: «если я заплачу, то я и заплачу». И хотя эмоциональная манипуляция не является чем-то новым, этичность скрытой рекламы в персональных помощниках вызывает большие вопросы.

Разработки, описанные выше, открывают новые перспективы во взаимодействии человека и искусственного интеллекта. Компьютер все более воспринимается как самостоятельный участник коммуникации: он уже научился генерировать текст и речь, а теперь учится и эмоциям. Все это нашло отражение в парадигме CASA (Computers Are Social Actors),а кто-то даже видит в персональных помощниках возможность стать личным ангелом-хранителем, который будет эмоционально поддерживать человека на протяжении всего дня. Однако прежде чем прийти к этому идеалу, необходимо выработать правила приватности и должной дистанции между ИИ и человеком. Такие правила помогут соблюсти баланс между выгодой для разработчиков и пользой такого взаимодействия для человека.